Forscher erfassen nur mit Webkamera die Bewegungen einer Person als 3-D-Modell

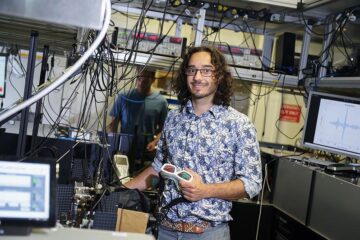

Das neue System setzt nur eine preiswerte Web-Kamera voraus, um das 3-D-Bewegungsmodell einer Person in Echtzeit zu erstellen. Foto: Oliver Dietze

„Mit unserem System können Sie sogar in den Alpen ein 3-D-Bewegungsmodell erstellen, sogar in Echtzeit und mit der Kamera ihres Smartphones“, sagt Dushyant Mehta, Doktorand am Max-Planck-Institut für Informatik (MPI) die Vorzüge des neuen Systems, das er mit seinen Kollegen aus der Gruppe „Graphics, Vision and Video“ entwickelt hat. Die Gruppe wird von Professor Christian Theobalt geleitet.

„Bisher war das nur mit mehreren Kameras oder einer so genannten Tiefenkamera möglich, die beispielsweise auch in die Kinect von Microsoft eingebaut ist“, erklärt Srinath Sridhar, der ebenfalls am MPI forscht.

Den Fortschritt ermöglicht eine spezielle Art von neuronalem Netzwerk, das Forscher als „gefaltetes neuronales Netzwerk“ bezeichnen und das in Industrie und Wirtschaft unter dem Begriff „Deep Learning“ für Furore sorgt. Die Saarbrücker Forscher haben eine neue Methode entwickelt, um damit in kürzester Zeit aus den zweidimensionalen Informationen des Videostreams das dreidimensionale Abbild der Person zu berechnen. Wie das konkret aussieht, zeigt ein von den Wissenschaftlern erstelltes Kurzvideo auf ihrer Webseite.

Ein Forscher jongliert mit Keulen in der Tiefe eines Raumes, im Vordergrund zeigt ein Monitor die dazugehörige Videoaufnahme. Die Gestalt des Forschers wird hier von einem feingliedrigen, roten Strichmännchen überlagert. Egal, wie schnell oder wie weit der Forscher ausholt, das Strich-Skelett macht die gleichen Bewegungen, genauso wie die aufgepumpte Version im virtuellen Raum, dargestellt auf einem weiteren Monitor links daneben.

Die Forscher haben ihr System „VNect“ getauft. Bevor es die 3-D-Pose der Person vorhersagt, bestimmt es erst deren Position im Bild. Dadurch verschwendet es keine Rechenkraft für Bildregionen, die nichts von der Person zeigen. Das neuronale Netzwerk wurde dazu mit über zehntausend annotierten Bildern während des Maschinellen Lernens trainiert. So kann es die aktuelle 3-D-Pose in Form der entsprechenden Gelenkwinkel spezifizieren, die sich leicht in virtuelle Figuren überführen lassen.

„Mit VNect können in Zukunft noch mehr Menschen Computerspiele per Körperbewegung steuern. Sie brauchen weder eine eine teure Tiefenkamera, mehrere Kameras, noch müssen sie spezielle Marker tragen. Ihre Web-Kamera genügt. Damit sind sogar völlig neue Erfahrungen in der Virtuellen Realität möglich“, erklärt Mehta. Darüber hinaus ist VNect auch das erste System, das lediglich ein Video benötigt, um daraus das 3-D-Bewegungsmodell einer Person zu erstellen.

„Das Spektrum der möglichen Anwendungen für VNect ist daher enorm groß“, erklärt Professor Christian Theobalt, der die Gruppe „Graphics, Vision and Video“ am MPI leitet. „Die Bandbreite reicht von Mensch-Maschine-Interaktion zu Mensch-Roboter-Interaktion bis hin zu Industrie 4.0, wo Mensch und Roboter Seite an Seite arbeiten. Oder denken Sie an Autonomes Fahren. In Zukunft könnte das Auto mit Hilfe der Kamera die Bewegungen von Personen erfassen, um so auf deren Verhalten zu schließen“, so Professor Theobalt.

Noch stößt VNect jedoch auch an Grenzen. Die Genauigkeit des neuen Systems ist etwas geringer als die Genauigkeit von Systemen, die auf mehreren Kameras oder Markern basieren. VNect gerät auch in Schwierigkeiten, wenn das Gesicht der Person verdeckt ist und wenn die Bewegungen zu schnell sind oder zu wenig den gelernten Vorbildern entsprechen. Mehrere Personen vor der Kamera bereiten VNect ebenfalls Probleme.

Dennoch ist sich MPI-Forscher Srinath Sridhar sicher, dass sich VNect weiterentwickeln wird und bald so komplexe Szenen verarbeiten kann, dass es ohne Problem im Alltag einsetzbar ist.

VNect wurde unter der Leitung von Professor Christian Theobalt in der Gruppe „Graphics, Vision and Video“ am Max-Planck-Institut für Informatik umgesetzt. An dem Projekt wirkten neben Srinath Sridhar und Dushyant Mehta auch Oleksandr Sotnychenko, Helge Rhodin, Mohammad Shafiei, Professor Hans-Peter Seidel, Weipeng Xu und Dan Casas. Die Forscher werden VNect auf der größten Computer Vision Konferenz CVPR, im US-amerikanischen Honolulu, vom 21. bis 26. Juli, und auf der renommierten, internationalen Konferenz „SIGGRAPH“ in der US-amerikanischen Stadt Los Angeles vom 30. Juli bis 3. August zeigen.

Fragen beantworten:

Dushyant Mehta

Max-Planck-Institut für Informatik

Saarland Informatics Campus

Tel.: +49 681 9325 4022

E-mail: dmehta@mpi-inf.mpg.de

Professor Christian Theobalt

Max-Planck-Institut für Informatik

Saarland Informatics Campus

Tel.: +49 681 9325 4028

E-mail: theobalt@mpii.de

Media Contact

Weitere Informationen:

http://www.uni-saarland.deAlle Nachrichten aus der Kategorie: Informationstechnologie

Neuerungen und Entwicklungen auf den Gebieten der Informations- und Datenverarbeitung sowie der dafür benötigten Hardware finden Sie hier zusammengefasst.

Unter anderem erhalten Sie Informationen aus den Teilbereichen: IT-Dienstleistungen, IT-Architektur, IT-Management und Telekommunikation.

Neueste Beiträge

Neue universelle lichtbasierte Technik zur Kontrolle der Talpolarisation

Ein internationales Forscherteam berichtet in Nature über eine neue Methode, mit der zum ersten Mal die Talpolarisation in zentrosymmetrischen Bulk-Materialien auf eine nicht materialspezifische Weise erreicht wird. Diese „universelle Technik“…

Tumorzellen hebeln das Immunsystem früh aus

Neu entdeckter Mechanismus könnte Krebs-Immuntherapien deutlich verbessern. Tumore verhindern aktiv, dass sich Immunantworten durch sogenannte zytotoxische T-Zellen bilden, die den Krebs bekämpfen könnten. Wie das genau geschieht, beschreiben jetzt erstmals…

Immunzellen in den Startlöchern: „Allzeit bereit“ ist harte Arbeit

Wenn Krankheitserreger in den Körper eindringen, muss das Immunsystem sofort reagieren und eine Infektion verhindern oder eindämmen. Doch wie halten sich unsere Abwehrzellen bereit, wenn kein Angreifer in Sicht ist?…